数值计算 深度学习的数学基石 —— Deep Learning 读书系列第四章分享总结

在深度学习的浩瀚体系中,数学是理解其内在机理、优化模型性能的基石。第四章《数值计算》深入探讨了支撑现代深度学习算法的核心数学概念与计算技术。本次分享旨在提炼本章精华,帮助读者跨越理论与实践的桥梁。

核心主题:精度、稳定与优化

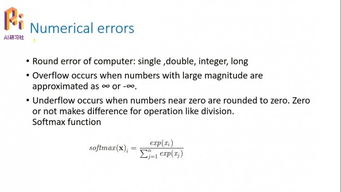

本章的核心围绕三个关键词展开:数值精度、数值稳定性和优化方法。深度学习模型本质上是复杂的数学函数,其训练与推理过程充斥着海量的浮点数运算。因此,理解计算机如何表示和处理这些数字(如上溢、下溢、舍入误差),是避免模型出现诡异行为(如梯度爆炸或消失)的第一步。数值稳定性,特别是在设计激活函数(如ReLU及其变体)和损失函数时,是确保模型能够顺利学习的关键。

优化:寻找最优解的旅程

优化是深度学习的引擎。本章系统性地介绍了从基础的梯度下降法到更高级的优化器(如动量法、Adam)的演进逻辑。重点阐述了:

- 梯度计算:通过雅可比矩阵和海森矩阵,我们不仅能知道参数更新的方向(梯度),还能了解更新步长的曲率信息(二阶优化)。虽然海森矩阵在深度学习中的直接应用因计算成本而受限,但其思想启发了许多自适应优化算法。

- 约束优化:现实问题常带有限制条件。本章介绍了处理约束的经典方法,如KKT条件,并简要提及了将其融入深度学习框架(例如,通过投影或惩罚项)的思路。

实践启示与“享读系统”

理论的价值在于指导实践。在“享读系统”的深度学习应用场景中,本章知识直接映射到以下环节:

- 模型训练:选择数值稳定的网络结构(如使用批归一化层),并针对文本、图像等不同模态的数据特性,选择合适的优化器及其超参数(学习率、动量系数)。

- 损失函数设计:确保损失函数在数值上是良定义的,避免在极端情况下(如预测概率为0或1)出现NaN(非数值)错误。

- 部署与推理:在将模型部署到资源受限的边缘设备时,常需要进行量化,即用更低精度的数值(如INT8)表示模型参数。这直接源于对数值表示与舍入误差的深刻理解,是精度与效率的权衡艺术。

与展望

《数值计算》一章或许没有展示炫酷的神经网络架构,但它揭示了所有华丽模型得以平稳运行的底层逻辑。它提醒我们,一个微小的梯度计算误差,经过多层网络的指数级放大,足以导致训练的彻底失败。掌握这些内容,意味着我们能更自信地调试模型,更精准地定位问题,并更有创意地改进算法。

在“享读系统”的持续迭代中,无论是提升推荐精度还是优化响应速度,数值计算的知识都将如影随形。让我们带着这份对数学的敬畏与洞察,继续探索深度学习的更深处。

—— 享读 Deep Learning 读书会,第四章分享

如若转载,请注明出处:http://www.fengshangxiangdu.com/product/9.html

更新时间:2026-06-06 08:42:49